论文地址:Unpaired Image-to-Image Translation using Cycle-Consistent Adversarial Networks

PyTorch代码:https://github.com/junyanz/pytorch-CycleGAN-and-pix2pix

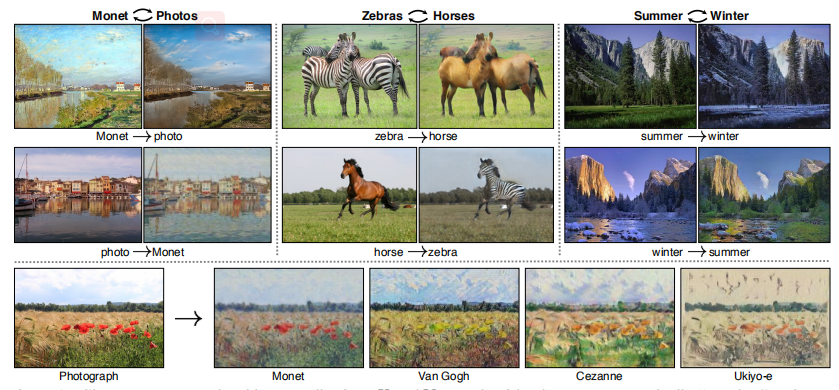

CycleGAN(或许)是首个将GAN用于风格迁移的网络。

CycleGAN的作用本质是Image2Image的风格迁移,并不是传统意义上的生成。

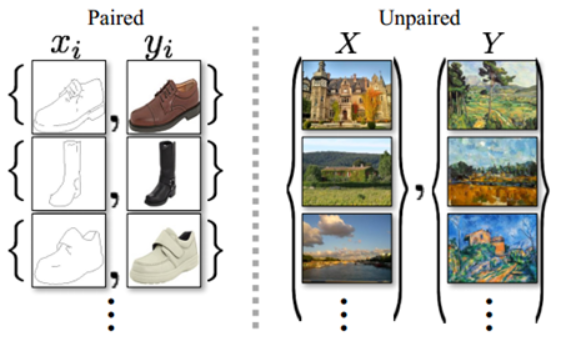

相比于其它Image2Image的网络,CycleGAN并不需要成对的样本数据用来训练,而仅仅需要两组无关的图片,其中目标样本通常为一组风格相似的图片集。

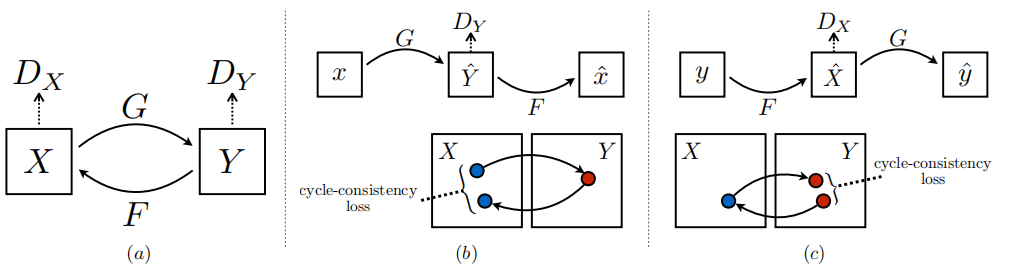

为了避免网络将X中所有样本映射到Y中的某一个样本,CycleGAN同时包含Y→X的映射,要求网络能够对自己生成的图片进行还原。这使得F(X)必须包含X的内容信息,因此更容易学习Y整体的风格信息(大概)。